This entry is parte 7 de 7 in the series

Zero TrustAo longo da série, o modelo foi construído progressivamente: sinais são coletados no cliente, transportados de forma consistente, estruturados no backend e utilizados em um processo contínuo de decisão. Esse fluxo estabelece uma base operacional onde cada requisição deixa de ser tratada como um evento isolado e passa a ser interpretada a partir do contexto em que ocorre.

Esse encadeamento resolve um problema real: a ausência de visibilidade sobre as condições de execução das requisições. O backend deixa de operar com base em suposições implícitas e passa a trabalhar com evidências observáveis, ainda que imperfeitas. A decisão deixa de depender exclusivamente da identidade e passa a considerar variáveis adicionais que qualificam cada interação.

No entanto, essa mudança não elimina o risco inerente ao sistema. Ela altera sua forma de manifestação.

No modelo tradicional, o risco está oculto sob premissas não verificadas, como a integridade do cliente ou a legitimidade do fluxo após a autenticação. No modelo proposto, essas premissas deixam de existir. O sistema passa a operar explicitamente sob incerteza, tratando cada requisição como uma hipótese a ser avaliada, e não como uma continuidade confiável de um estado previamente validado.

Essa transição desloca o problema de segurança. O objetivo deixa de ser estabelecer garantias absolutas e passa a ser reduzir incerteza de forma consistente e operacionalmente viável. A qualidade da decisão não decorre da eliminação do risco, mas da capacidade de identificá-lo, qualificá-lo e reagir a ele de forma estruturada.

Zero Trust não elimina a incerteza inerente ao sistema. Ele a expõe como variável operacional e a incorpora ao processo de decisão.

Esse ponto é central para compreender o limite do modelo. Ele não transforma o sistema em determinístico nem elimina cenários adversariais. O que ele fornece é um mecanismo para tratar risco de forma explícita, mensurável e evolutiva, dentro das restrições impostas pelo ambiente mobile e pela própria natureza distribuída da aplicação.

7.1. Limitações estruturais

A primeira limitação não é técnica, mas estrutural: o cliente permanece fora do domínio de controle do backend.

Independentemente da qualidade da coleta de sinais, da padronização do transporte ou da sofisticação da avaliação de risco, o sistema continua operando sobre dados provenientes de um ambiente que não pode ser controlado nem validado de forma contínua. Essa característica não é contingente à implementação, mas uma propriedade intrínseca de aplicações mobile.

Como consequência, todo o modelo se apoia em evidências cuja origem é, por definição, potencialmente adversarial.

Essa condição impõe limites claros à capacidade do sistema de estabelecer garantias fortes.

7.1.1. Cliente como superfície de manipulação

Nenhum mecanismo implementado no cliente elimina a possibilidade de manipulação do ambiente de execução ou do fluxo de requisições. O sistema deve assumir, como hipótese base, que o cliente pode ser controlado.

Isso inclui cenários como:

execução em ambientes controlados, como emuladores ou dispositivos comprometidos

modificação do comportamento da aplicação por instrumentação ou alteração do binário

interceptação, inspeção e reconstrução de requisições fora do fluxo original

simulação completa de chamadas sem utilização do aplicativo oficial

Essas possibilidades não representam exceções, mas capacidades inerentes ao ambiente. Do ponto de vista do backend, a forma da requisição pode permanecer válida mesmo quando seu processo de geração foi completamente desviado do comportamento esperado.

Por essa razão, o cliente não pode ser tratado como fonte de verdade. Ele atua como ponto de observação, não como entidade confiável.

Zero Trust não elimina essa limitação. Ele a assume explicitamente e estrutura o sistema para operar apesar dela.

7.1.2. Sinais como evidência imperfeita

Os sinais coletados no cliente não estabelecem garantias. Eles representam evidências parciais sobre o contexto da requisição.

Mesmo quando corretamente coletados e transportados, esses dados permanecem:

potencialmente manipuláveis, pois dependem de um ambiente não confiável

incompletos, pois não capturam integralmente o estado real da execução

sujeitos a inconsistência, tanto por falhas legítimas quanto por interferência externa

Essa característica define o limite semântico dos sinais. Eles não são utilizados como prova, mas como indício.

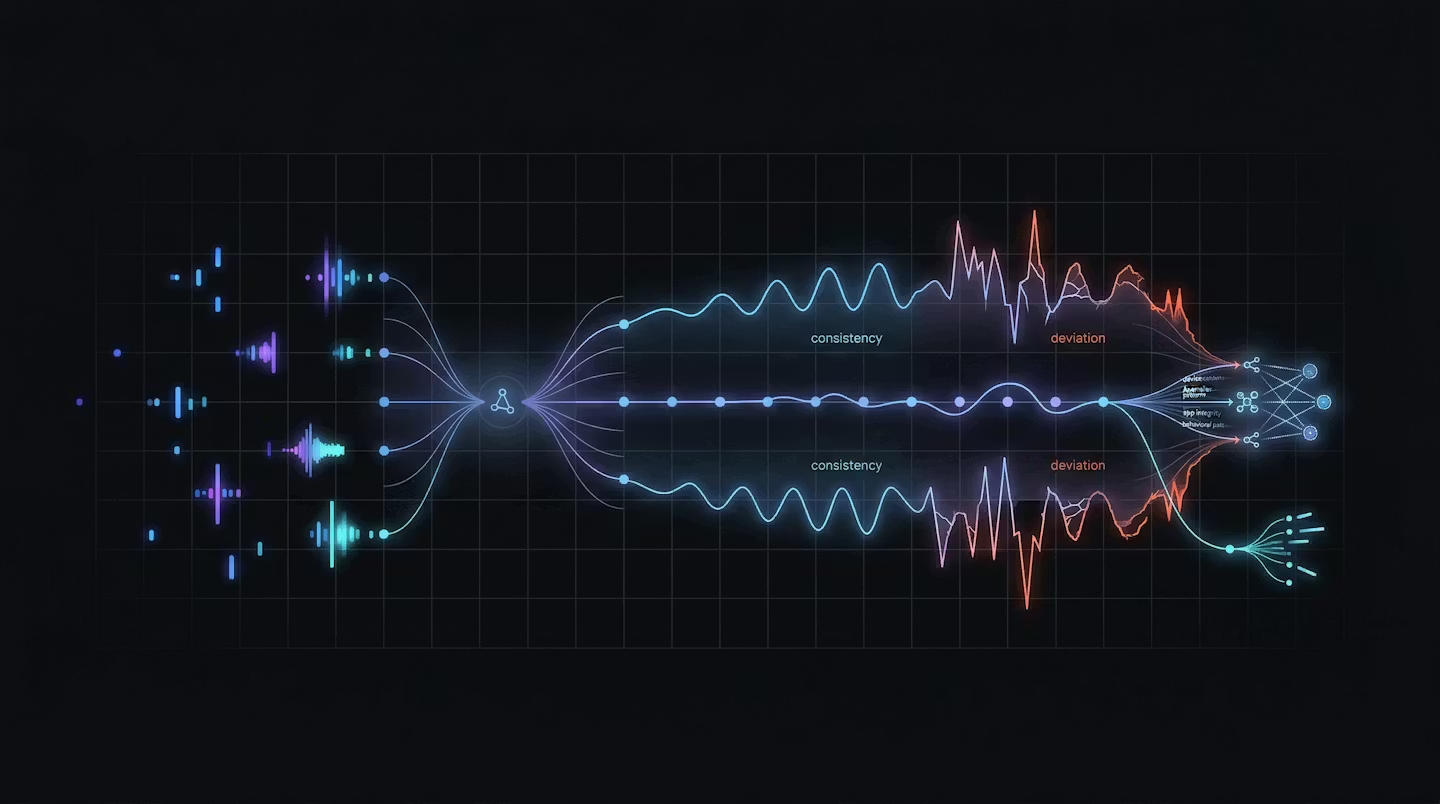

O valor desses dados não está na sua confiabilidade individual, mas na sua capacidade de serem correlacionados. É a consistência entre múltiplas dimensões, observada ao longo do tempo, que permite reduzir a incerteza associada à requisição.

Como consequência, a decisão deixa de ser determinística. O sistema não valida estados absolutos, mas avalia cenários com base em evidências imperfeitas, operando necessariamente em termos probabilísticos.

Ausência de garantias fortes sem atestação

Sem mecanismos de atestação de integridade, o sistema não possui meios robustos para validar propriedades fundamentais do cliente.

Entre essas propriedades, destacam-se:

a integridade do binário em execução

o estado do ambiente, incluindo instrumentação, debug ou comprometimento

a autenticidade da instância que originou a requisição

Mecanismos como Play Integrity ou App Attestation introduzem sinais com maior grau de verificabilidade, pois permitem validação criptográfica no backend. No entanto, mesmo nesses casos, a garantia permanece limitada.

Esses mecanismos aumentam o custo de falsificação e reduzem a superfície de ataque, mas não eliminam completamente a possibilidade de manipulação. Além disso, estão sujeitos a restrições operacionais, como latência, limites de uso e dependência de serviços externos.

O papel da atestação não é estabelecer confiança absoluta, mas elevar a qualidade da evidência disponível.

7.1.3. Simulação coordenada

A limitação mais relevante, e frequentemente negligenciada, é a possibilidade de simulação coordenada.

À medida que o modelo passa a depender da correlação entre múltiplos sinais e da consistência ao longo do tempo, surge um novo vetor de ataque: a reprodução controlada de um conjunto coerente de evidências.

Um agente com capacidade suficiente pode:

reproduzir múltiplos sinais de forma consistente entre si

simular continuidade de comportamento ao longo de múltiplas interações

manter coerência temporal entre requisições sucessivas

adaptar respostas para evitar detecção por regras simples de inconsistência

Esse tipo de ataque não depende da falsificação de um único sinal, mas da construção de um contexto plausível como um todo. Ele explora exatamente o mecanismo que sustenta o modelo: a correlação.

Embora mais complexo do que manipulações isoladas, esse cenário é viável em sistemas de alto valor, onde há incentivo suficiente para investimento em automação e instrumentação avançada.

Nesse ponto, o modelo atinge seu limite estrutural. Ele não impede a simulação, mas aumenta o custo necessário para realizá-la de forma consistente.

A consequência é clara: o sistema reduz a probabilidade de erro e eleva a barreira de ataque, mas não elimina a possibilidade de cenários adversariais sofisticados.

7.2. Custos operacionais

A adoção de um modelo baseado em contexto não é gratuita. Ela introduz custos que não são apenas técnicos, mas estruturais, e que impactam diretamente a viabilidade do sistema ao longo do tempo.

Diferentemente de modelos centrados em identidade, onde a decisão é pontual e o custo é concentrado no momento da autenticação, o modelo baseado em evidência distribui esse custo ao longo de toda a interação. Cada requisição passa a carregar não apenas uma operação, mas também um processo de avaliação.

Como consequência, segurança deixa de ser um componente isolado e passa a ser uma preocupação transversal, com impacto contínuo sobre arquitetura, performance e operação.

7.2.1. Complexidade arquitetural

O sistema deixa de ser uma API orientada a identidade e passa a incorporar múltiplas camadas interdependentes:

coleta estruturada de sinais no cliente

contratos explícitos de transporte

construção e normalização de contexto no backend

avaliação de risco como função definida

mecanismos de resposta dinâmica, como step-up

Cada uma dessas camadas introduz novos pontos de falha, novos fluxos de dados e novas dependências entre componentes.

Essa complexidade não é apenas quantitativa, mas qualitativa. O comportamento do sistema deixa de ser linear e passa a depender da interação entre múltiplas dimensões de contexto, o que dificulta previsibilidade, teste e depuração.

Sem disciplina arquitetural, o modelo tende a degradar rapidamente para um conjunto de regras locais, inconsistentes entre si, onde decisões passam a depender de condições implícitas e não documentadas. Nesse estado, o sistema mantém a aparência de sofisticação, mas perde coerência operacional.

7.2.2. Latência

A introdução de avaliação contínua impacta diretamente o tempo de resposta do sistema.

Etapas como:

validação e normalização de sinais

correlação com histórico

execução da função de risco

eventuais mecanismos de step-up

adicionam processamento ao fluxo de cada requisição.

Esse impacto não é uniforme. Em cenários de baixo risco, a latência pode ser marginal. Em cenários intermediários ou incertos, a introdução de validações adicionais pode alterar significativamente o tempo de resposta percebido.

Em aplicações mobile, esse custo é particularmente sensível. Pequenos aumentos de latência podem comprometer a experiência do usuário, especialmente em operações interativas ou de alta frequência.

Isso impõe um limite prático: o modelo precisa equilibrar profundidade de análise com responsividade, sob risco de degradar a usabilidade do sistema.

7.2.3. Custo operacional

O backend passa a assumir responsabilidades adicionais que não existem em modelos tradicionais:

armazenamento e gerenciamento de histórico de contexto

processamento contínuo de sinais a cada requisição

infraestrutura para observabilidade, auditoria e análise

manutenção de pipelines de decisão e classificação de risco

Esses elementos aumentam não apenas o consumo de recursos computacionais, mas também o custo de operação e sustentação do sistema.

Além disso, a dependência de dados históricos e de processamento adicional torna o sistema mais sensível à escala. À medida que o volume de requisições cresce, o custo não se limita à capacidade de processamento, mas também à complexidade da análise associada a cada interação.

Esse crescimento não linear exige planejamento específico de capacidade e pode limitar a adoção do modelo em cenários de alto volume sem uma arquitetura adequada.

7.2.4. Manutenção de regras

Modelos baseados em risco não são estáticos. Eles dependem de ajuste contínuo para permanecerem relevantes.

Isso inclui:

calibração de limiares e critérios de decisão

revisão de heurísticas à medida que o comportamento do sistema evolui

tratamento de falsos positivos e negativos

adaptação a novos padrões de uso e novos vetores de ataque

Esse processo não pode ser tratado como manutenção ocasional. Ele exige governança contínua.

Sem mecanismos claros de versionamento, observabilidade e validação de mudanças, o sistema tende a se tornar opaco. Regras acumuladas ao longo do tempo passam a interagir de forma imprevisível, dificultando a compreensão do comportamento global.

Nesse cenário, o risco não está apenas na falha de detecção, mas na perda de controle sobre o próprio modelo. A complexidade deixa de ser gerenciada e passa a ser herdada, comprometendo a capacidade de evolução do sistema.

7.3. Trade-offs inevitáveis

Os custos introduzidos pelo modelo não se manifestam apenas como impacto operacional. Eles se traduzem em decisões arquiteturais que impõem compromissos explícitos, sem solução ótima universal.

Cada ajuste em uma dimensão do sistema tende a degradar outra. O objetivo deixa de ser otimizar isoladamente e passa a ser equilibrar variáveis conflitantes dentro de limites operacionais aceitáveis.

7.3.1. Segurança vs usabilidade

O aumento do rigor na avaliação de risco impacta diretamente a experiência do usuário.

Maior exigência de evidência implica:

introdução de desafios adicionais (validações ativas)

maior frequência de bloqueios preventivos

aumento da fricção ao longo do fluxo de uso

Por outro lado, reduzir fricção exige aceitar maior incerteza nas decisões e, consequentemente, maior exposição ao risco.

Esse compromisso não pode ser resolvido apenas com critérios técnicos. Ele depende do contexto de uso do sistema, do perfil de risco aceitável e dos objetivos do produto.

A arquitetura define o que é possível. A decisão sobre onde posicionar esse equilíbrio é de natureza estratégica.

7.3.2. Recência vs custo

A qualidade da decisão depende da atualidade dos sinais utilizados.

Sinais mais recentes tendem a refletir melhor o estado real do ambiente, reduzindo a probabilidade de decisões baseadas em contexto desatualizado. No entanto, essa recência exige:

maior frequência de coleta

maior consumo de recursos no cliente

maior volume de processamento no backend

impacto adicional na latência

Por outro lado, a reutilização de sinais reduz custo e melhora a eficiência operacional, mas amplia a janela de incerteza. O sistema passa a operar com dados potencialmente defasados em relação ao estado atual da requisição.

Esse compromisso foi formalizado na definição de validade dos sinais. Recência e custo são dimensões diretamente conflitantes, e a escolha de seus parâmetros define o nível de risco que o sistema está disposto a assumir.

7.3.3. Precisão vs complexidade

O aumento da sofisticação do modelo tende a melhorar a capacidade de detecção, mas introduz complexidade adicional.

Modelos mais elaborados permitem decisões mais refinadas, mas implicam:

maior dificuldade de compreensão e explicação

aumento do custo de manutenção

maior acoplamento entre componentes

maior risco de comportamento emergente não previsto

Por outro lado, abordagens mais simples reduzem a capacidade de detecção, mas mantêm o sistema mais previsível, auditável e operável.

Esse compromisso define um limite importante: a precisão do modelo não pode ser avaliada isoladamente. Ela precisa ser considerada em conjunto com a capacidade do sistema de ser compreendido, mantido e evoluído ao longo do tempo.

7.4. Evoluções possíveis

Apesar das limitações estruturais, o modelo permite evolução incremental. Essa evolução não altera seus fundamentos, mas amplia a qualidade das evidências disponíveis e a capacidade do sistema de interpretá-las.

É importante destacar que essas evoluções não eliminam a incerteza inerente ao ambiente. Elas atuam sobre a redução de ambiguidade e sobre o aumento do custo necessário para manipulação consistente do contexto.

7.4.1. Atestação de integridade

Mecanismos de atestação introduzem sinais com propriedades distintas dos demais, pois permitem validação independente no backend.

Soluções como:

Play Integrity (Android)

App Attestation (iOS)

fornecem evidências baseadas em garantias criptográficas, associadas ao estado da aplicação e do ambiente no momento da coleta.

Essa característica altera a qualidade do sinal. Diferentemente de dados puramente observacionais, esses mecanismos permitem verificar:

integridade do binário em execução

condições do ambiente, como debug, emulação ou comprometimento

autenticidade da instância que originou a requisição

No entanto, essas garantias não são absolutas. Elas estão sujeitas a limitações operacionais, como latência, dependência de serviços externos e restrições de uso, além de não eliminarem completamente a possibilidade de bypass em cenários sofisticados.

O papel da atestação não é resolver o problema de confiança, mas elevar o custo de falsificação e introduzir sinais com maior grau de verificabilidade no modelo.

7.4.2. Identificação de dispositivo mais robusta

A evolução do identificador de dispositivo representa uma tentativa de aumentar a estabilidade da referência utilizada para continuidade de contexto.

Modelos mais sofisticados podem incorporar múltiplos elementos, como:

características persistentes da instalação

atributos do ambiente de execução

sinais indiretos derivados de comportamento ou configuração

Isso permite:

maior resistência a reinicialização ou reinstalação

melhor detecção de mudanças abruptas de ambiente

aumento da consistência na correlação de histórico

No entanto, essa evolução não transforma o identificador em uma prova de identidade. Ele continua sendo uma construção lógica, sujeita a replicação, simulação ou substituição em ambientes controlados.

O ganho não está na confiabilidade absoluta, mas na dificuldade crescente de manter consistência ao longo do tempo em cenários de manipulação.

7.4.3. Avaliação de risco adaptativa

A substituição de regras fixas por modelos adaptativos permite que o sistema evolua de forma mais dinâmica.

Em vez de depender exclusivamente de critérios estáticos, a avaliação de risco passa a incorporar:

ajuste de limiares com base em comportamento observado

adaptação a padrões reais de uso

evolução contínua sem necessidade de reconfiguração manual constante

Essa abordagem reduz dependência de regras rígidas e melhora a capacidade do sistema de responder a mudanças no ambiente e no perfil de uso.

No entanto, essa evolução introduz novos desafios:

maior dificuldade de explicação das decisões

aumento da complexidade operacional

necessidade de controle rigoroso sobre o comportamento do modelo

A adaptabilidade melhora a precisão, mas reduz previsibilidade. Esse compromisso precisa ser gerenciado explicitamente.

7.4.4. Modelos comportamentais

A incorporação de análise de comportamento adiciona uma dimensão que não depende diretamente de dados fornecidos pelo cliente, mas emerge da observação das interações ao longo do tempo.

Essa abordagem permite detectar:

automação e uso não humano

padrões anômalos de interação

desvios em relação ao histórico esperado

Diferentemente de sinais estáticos, o comportamento é difícil de simular de forma consistente, pois exige coerência ao longo de múltiplas dimensões e interações.

No entanto, essa abordagem possui características próprias:

depende de histórico suficiente para estabelecer referência

é sensível a mudanças legítimas de comportamento

exige definição cuidadosa de critérios para evitar falsos positivos

Além disso, sua implementação tende a ser mais complexa, pois envolve modelagem de padrões e análise contínua de dados.

Ainda assim, quando bem aplicada, essa dimensão complementa os demais sinais e amplia significativamente a capacidade de detecção do sistema.

7.4.5. Modelos baseados em aprendizado

A utilização de modelos baseados em aprendizado permite ampliar a capacidade do sistema de interpretar contexto, especialmente em cenários onde a correlação entre sinais não é trivial.

Esses modelos atuam principalmente na função de avaliação de risco, substituindo ou complementando heurísticas fixas por mecanismos capazes de:

identificar padrões complexos em múltiplas dimensões

adaptar-se ao comportamento real do sistema ao longo do tempo

detectar anomalias que não seriam capturadas por regras explícitas

Essa abordagem melhora a capacidade de classificação e reduz a dependência de calibração manual.

No entanto, ela não altera as limitações fundamentais do modelo.

Os dados de entrada continuam sendo provenientes de um ambiente potencialmente adversarial, o que implica que a qualidade da decisão permanece limitada pela qualidade da evidência disponível.

Além disso, modelos baseados em aprendizado introduzem novos desafios:

redução da explicabilidade das decisões

aumento da complexidade operacional

necessidade de governança sobre o comportamento do modelo

Essa evolução amplia a capacidade de análise, mas não elimina a incerteza. Assim como nas demais dimensões, o ganho está na melhoria da interpretação, não na obtenção de garantias absolutas.

A IA, nesse contexto, não introduz confiança no sistema. Ela apenas refina a forma como a incerteza é estimada, permanecendo como mais um componente probabilístico dentro do processo de decisão.

7.5. O posicionamento final

Ao final da série, o modelo pode ser avaliado de forma mais precisa, não apenas como uma proposta conceitual, mas como um sistema operacional sujeito a restrições, limites e escolhas arquiteturais.

Zero Trust não transforma o sistema em seguro no sentido absoluto. Essa não é uma propriedade que possa ser garantida em ambientes onde o cliente está fora do domínio de controle. O que o modelo altera é a forma como o sistema trata a incerteza inerente às interações.

No modelo tradicional, o risco é frequentemente ocultado por premissas implícitas, como a integridade do cliente ou a legitimidade do fluxo após a autenticação. Essas premissas não são verificadas, mas sustentam decisões ao longo de toda a sessão.

No modelo proposto, essas suposições são removidas. A decisão deixa de depender de confiança herdada e passa a ser construída a partir de evidências observáveis, ainda que imperfeitas.

O deslocamento fundamental pode ser descrito de forma estrutural:

de confiança implícita para evidência explícita

de decisão pontual para avaliação contínua

de estado para processo

Essa mudança redefine a natureza da segurança dentro do sistema. A legitimidade de uma ação deixa de ser inferida a partir de um evento passado, como a autenticação, e passa a ser avaliada no momento em que a requisição ocorre, considerando o contexto disponível.

Como consequência, a segurança deixa de ser uma propriedade estática associada a uma sessão e passa a emergir de um processo contínuo de observação, interpretação e decisão.

Esse modelo não elimina o risco nem torna o sistema determinístico. O que ele permite é tratar o risco como uma variável operacional, incorporando-o ao fluxo de decisão de forma explícita.

Isso viabiliza três capacidades fundamentais:

observar o risco, por meio da coleta e correlação de evidências

medi-lo, através de modelos de avaliação consistentes

reagir a ele, aplicando respostas proporcionais ao nível de incerteza

A segurança deixa, portanto, de ser entendida como um estado alcançado e passa a ser tratada como um processo em execução contínua, cuja qualidade depende da capacidade do sistema de lidar com evidências imperfeitas em um ambiente inerentemente não confiável.

segurança não é um estado. É um processo operacional contínuo

7.6. Síntese da série

A evolução construída ao longo dos artigos pode ser compreendida como um encadeamento lógico, onde cada etapa resolve uma limitação específica do modelo anterior e introduz uma nova dimensão ao sistema:

a autenticação resolve o problema de identidade, mas não o de contexto

o contexto passa a ser representado por sinais observáveis

esses sinais precisam ser coletados e transportados de forma consistente

o backend interpreta essas evidências e as transforma em decisões

o histórico introduz continuidade, permitindo análise ao longo do tempo

e, por fim, o modelo é limitado por custos, imperfeições e trade-offs inerentes ao ambiente

Esse encadeamento não é apenas uma decomposição arquitetural. Ele representa uma mudança progressiva na forma como o sistema interpreta requisições e constrói decisões.

Cada etapa reduz uma classe de incerteza, mas nenhuma delas a elimina. O modelo evolui não no sentido de alcançar garantias absolutas, mas de estruturar a incerteza de forma incremental e operável.

O resultado não é um sistema “seguro” em termos absolutos, mas um sistema capaz de lidar com risco de maneira explícita, mensurável e adaptativa.

Nesse sentido, o percurso descrito ao longo da série define mais do que uma arquitetura. Ele estabelece um modelo mental para tratar segurança em aplicações mobile, onde o cliente não pode ser considerado confiável e o backend precisa operar continuamente sob incerteza, tomando decisões com base em evidências imperfeitas, porém correlacionáveis.

CONSULTE MAIS INFORMAÇÃO